Według informacji przesłanych przez Nvidię, sztuczna inteligencja może pomóc w usprawnieniu wideokonferencji.

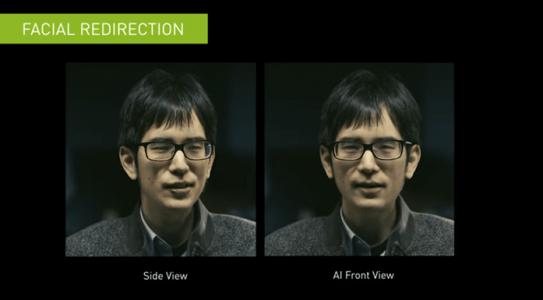

Vid2Vid Cameo, jeden z modeli uczenia głębokiego stojących za pakietem SDK NVIDIA Maxine do wideokonferencji; Wykorzystuje wrogie sieci generacji, znane jako GAN, do syntezy realistycznych filmów gadających głów przy użyciu obrazu 2D osoby.

Sztuczna inteligencja usprawnia wideokonferencje

Oznacza to, że uczestnik spotkania w zmierzwionych włosach i piżamie może wyglądać na formalną koszulę; Podczas gdy sztuczna inteligencja odwzorowuje ruchy twarzy użytkownika za pomocą wstępnie załadowanego zdjęcia osoby, z odpowiednim strojem do pracy. Jeśli obiekt jest zwrócony w lewo, technologia może dostosować punkt widzenia tak, aby asystent wydawał się nawiązywać kontakt wzrokowy z kamerą internetową.

Oprócz pomagania uczestnikom spotkania wyglądać jak najlepiej; Ta technologia AI zmniejsza również przepustowość wymaganą do wideokonferencji nawet 10-krotnie, eliminując migotanie i opóźnienia w odbiorze obrazu. Wkrótce będzie dostępny w postaci pliku w zestawie SDK kodeka wideo NVIDIA Kodek AI twarzy.

Sztuczna inteligencja kradnie show.

Ukłon w stronę klasycznych filmów o napadach (i popularnego programu Netflix); Badacze firmy NVIDIA przygotowali formularz GAN jako głównego rzecznika, aby umożliwić Ci udział w wirtualnym spotkaniu. Demo przedstawia główne funkcje Vid2Vid Cameo, w tym przekazywanie twarzy, animowane awatary i kompresję danych.

Te możliwości będą wkrótce dostępne w pakiecie SDK NVIDIA Maxine, który zapewnia programistom ulepszone, przeszkolone modele efektów wideo, audio i AR do wideokonferencji i transmisji na żywo.

Deweloperzy mogą teraz stosować efekty Maxine AI; Obejmuje inteligentne usuwanie szumów, powiększanie wideo i szacowanie postawy. Bezpłatny pakiet SDK do pobrania można również zintegrować z platformą NVIDIA Jarvis do konwersacyjnych aplikacji AI, w tym transkrypcji i tłumaczenia.

Pozdrawiam przez AI.

Vid2Vid Cameo wymaga tylko dwóch elementów, aby stworzyć realistyczną gadającą głowę AI do wideokonferencji: pojedyncze ujęcie wyglądu osoby i kanał wideo przedstawiający sposób animowania tego obrazu.

Model został przeszkolony w systemie NVIDIA DGX, przy użyciu zestawu danych zawierającego 180 000 wysokiej jakości mówiących filmów. Sieć nauczyła się identyfikować 20 kluczowych punktów, które można wykorzystać do modelowania ruchu twarzy bez adnotacji ludzkich. Kropki symbolizują położenie takich cech, jak oczy, usta i nos.

Te kluczowe punkty są następnie wyodrębniane z obrazu referencyjnego osoby dzwoniącej; które można wcześniej wysłać do innych uczestników wideokonferencji lub wykorzystać ponownie z poprzednich spotkań. W ten sposób zamiast wysyłać ogromne strumienie wideo na żywo od jednego uczestnika do drugiego; Platformy do wideokonferencji mogą po prostu wysyłać dane o tym, jak poruszają się kluczowe punkty twarzy mówcy.

Zmniejsz przepustowość

Po stronie odbiornika model GAN wykorzystuje te informacje do kompilacji wideo, które symuluje wygląd obrazu referencyjnego.

Dzięki kompresji i przesyłaniu tylko pozycji głowy i kluczowych punktów tam iz powrotem, a nie całych sekwencji wideo, technologia ta może zmniejszyć wymagania dotyczące przepustowości wideokonferencji nawet 10-krotnie, zapewniając płynniejsze wrażenia użytkownika. Model można zmodyfikować tak, aby rozgłaszał różną liczbę kluczowych punktów, aby pasował do różnych środowisk przepustowości bez pogorszenia jakości wizualnej.

Wynikowy punkt widzenia gadającej głowicy można również dowolnie dostosować, aby oglądać użytkownika z boku lub z profilu prostego, a także z niższego lub wyższego kąta kamery. Ta funkcja może być również stosowana przez edytorów obrazów, którzy pracują z obrazami nieruchomymi.

Badacze NVIDIA odkryli, że Vid2Vid Cameo przewyższa wiodące modele, zapewniając ostrzejsze, bardziej realistyczne wyniki, niezależnie od tego, czy obraz referencyjny i wideo pochodzą od tej samej osoby, czy też gdy sztuczna inteligencja ma za zadanie przesyłać ruch od jednej osoby do obrazu referencyjnego innej osoby.

Ta ostatnia funkcja może być wykorzystana do zastosowania ruchów twarzy głośnika w celu animowania cyfrowego awatara, nadając postaci z kreskówek realistyczny wyraz i ruch.

Więcej informacji na temat sztucznej inteligencji znajdziesz tutaj Połączyć.

„Amatorski praktykujący muzykę. Wieloletni przedsiębiorca. Odkrywca. Miłośnik podróży. Nieskrępowany badacz telewizji.”

:quality(75)/cloudfront-us-east-1.images.arcpublishing.com/elcomercio/G73RL2I77RHUTF4Z247S57H3NM.jpg)

:quality(85)/cloudfront-us-east-1.images.arcpublishing.com/infobae/JCHP4WQPAJE7BLT42T6S57PYRY.jpg)